Mục lục:

- Hiệu suất vượt trội của Cerebras Inference trên mô hình Llama 3.1 405B

- Công nghệ đột phá của Cerebras Systems

- Phản hồi tích cực từ Meta

- Khả năng ứng dụng và giá cả

- Kết luận

- Hiệu suất vượt trội của Cerebras Inference trên mô hình Llama 3.1 405B

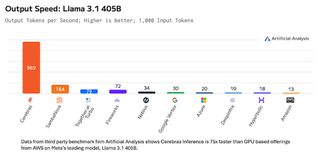

Công ty Cerebras Systems vừa công bố một bước đột phá đáng kể trong lĩnh vực trí tuệ nhân tạo (AI). Hệ thống Cerebras Inference đã đạt được tốc độ xử lý mô hình ngôn ngữ lớn Llama 3.1 405B của Meta với hiệu suất chưa từng có: 969 token/giây. Theo công ty phân tích hiệu năng độc lập Artificial Analysis, tốc độ này nhanh hơn tới 75 lần so với các giải pháp dựa trên GPU của các nhà cung cấp dịch vụ điện toán đám mây hàng đầu như AWS (13 token/giây), Azure (20 token/giây), và gần 6 lần so với SambaNova (164 token/giây) và hơn 14 lần so với Google Vertex (30 token/giây).

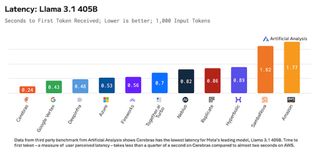

Không chỉ về tốc độ, Cerebras Inference còn ghi nhận thời gian phản hồi cực nhanh: chỉ 240 mili giây để tạo ra token đầu tiên. Con số này nhanh gấp đôi so với Google Vertex (430 mili giây) và vượt xa AWS (1770 mili giây).

- Công nghệ đột phá của Cerebras Systems

Thành tựu ấn tượng này đến từ hệ thống Cerebras Inference, được xây dựng trên siêu máy tính CS-3 và bộ xử lý AI Wafer Scale Engine 3 (WSE-3). WSE-3, được mệnh danh là "con chip AI nhanh nhất thế giới", sở hữu 44GB bộ nhớ SRAM tích hợp, 4 nghìn tỷ transistor, và 900.000 lõi được tối ưu hóa cho AI. Nó đạt hiệu năng AI đỉnh cao 125 petaflops và sở hữu băng thông bộ nhớ cao hơn gấp 7000 lần so với Nvidia H100.

- Phản hồi tích cực từ Meta

Ahmad Al-Dahle, Phó Chủ tịch mảng GenAI của Meta, đã đánh giá cao kết quả mà Cerebras đạt được: "Việc mở rộng khả năng suy luận là vô cùng quan trọng để thúc đẩy đổi mới AI và mã nguồn mở. Nhờ nỗ lực đáng kinh ngạc của đội ngũ Cerebras, Llama 3.1 405B hiện là mô hình tiên tiến nhanh nhất thế giới. Thông qua sức mạnh của Llama và cách tiếp cận mở của chúng tôi, việc suy luận siêu nhanh và giá cả phải chăng giờ đây đã nằm trong tầm tay của nhiều nhà phát triển hơn bao giờ hết."

- Khả năng ứng dụng và giá cả

Việc chạy các mô hình lớn với tốc độ "tức thì" mở ra nhiều ứng dụng mới đầy tiềm năng, bao gồm khả năng lập luận và hợp tác đa tác nhân trong nhiều lĩnh vực AI. Cerebras hiện đang tiến hành thử nghiệm hệ thống cho khách hàng, với kế hoạch ra mắt chính thức vào quý 1 năm 2025. Giá khởi điểm là 6 đô la Mỹ cho một triệu token đầu vào và 12 đô la Mỹ cho một triệu token đầu ra.

- Kết luận

Cerebras Systems đã chứng minh sức mạnh vượt trội của hệ thống Cerebras Inference so với các đối thủ cạnh tranh hàng đầu trong lĩnh vực AI. Với tốc độ và hiệu quả đáng kinh ngạc, Cerebras Inference hứa hẹn sẽ cách mạng hóa cách thức chúng ta tương tác và ứng dụng AI trong tương lai.

0 comments Blogger 0 Facebook

Đăng nhận xét